Het is 8 uur 's morgens. Je vrije slaap cyclus alarm wekt je, en je controleert het weer van vandaag op je telefoon. Tegen de tijd dat je een prachtige zonsopgangsfoto met je ochtendkopje koffie op Instagram hebt gepost, zijn je handelingen gevolgd, geregistreerd, opgeslagen en verkocht. Maar het zijn niet alleen jouw gegevens die zijn vastgelegd. Je neefje, collega, tante en beste vriend zijn ook vastgelegd. De hele samenleving van smartphonebezitters is vastgelegd (dat is de hele samenleving behalve de slimme paar resistente hippies). Waarom hebben miljoenen en miljoenen mensen massasurveillance laten gebeuren? (HINT: het zijn enkele van de gevaarlijke gedachten die hieronder worden weergegeven)

In deze artikelreeks wil ik de psychologische en culturele redenen achter het privacyprobleem van het internet blootleggen:

- Welke gedachten en ideeën hebben techbedrijven in staat gesteld enorme hoeveelheden persoonlijke gegevens te stelen?

- Hoe zijn hele samenlevingen akkoord gegaan met wereldwijde massasurveillance?

- Waarom zijn zoveel mensen akkoord met bewakingstechnologie die hun gegevens verkoopt aan de hoogste bieder?

Ik ben benieuwd hoe vaak u tijdens het lezen van dit artikel met uw hoofd knikt: "Ja, dat dacht ik ook, en ja, dat was dom." Ik weet dat ik er heel wat schuldig heb gedacht.

Samen verkennen we enkele geschiedenissen en wetenschappelijke inzichten om een licht te werpen op de privacy-paradox en belangrijke inzichten over onszelf en de samenleving te leren. Waarom? Omdat privacy uiteindelijk geen technologieprobleem is, maar een probleem veroorzaakt door menselijke beslissingen. Ik wil weten waarom die beslissingen zijn genomen (zonder iemand de schuld te geven), zodat we ervan kunnen leren en onze fouten kunnen corrigeren om ieders fundamentele recht op privacy te beschermen.

Ik geloof dat de oplossing voor een privacy-vriendelijk internet een stap-voor-stap proces is:

- Eerst moeten we onszelf, onze denkfouten en onze beslissingen begrijpen.

- Vervolgens moeten we betere oplossingen vinden voor de vraag wat we willen bereiken.

Willen we een internet vol advertenties die om onze aandacht vechten? Of willen we een internet waar mensen vrij kunnen leren, met elkaar in contact kunnen komen en fundamentele problemen kunnen oplossen?

- Waarom willen gebruikers hun privacy inruilen voor het gebruik van technologie?

- Gedachte 1: "Ik vind het OK om wat privacy weg te geven als het voor het grotere goed is."

- Gedachte 2: Computers zijn veel slimmer dan ik.

- Gedachte 3: "Deze hulpmiddelen helpen ons onze doelen te bereiken."

- Gedachte 4: "Technologie zal altijd de oplossing blijven en niet het probleem worden."

- Gedachte 5: "Uiteindelijk beslis ik."

Waarom willen gebruikers hun privacy inruilen voor het gebruik van technologie?

In dit eerste artikel van deze serie kijken we naar de gedachten van internetgebruikers. Waarom willen we hulpmiddelen en technologie zo graag dat we het goed vinden om onze privacy in te ruilen om ze te gebruiken?

Hieronder vindt u de eerste vijf gevaarlijk veel voorkomende gedachten (of hersenscheten) die ik vond:

(er zijn er waarschijnlijk veel meer, laat me je ideeën weten en ik zal er in latere artikelen over schrijven)

Gedachte 1: "Ik vind het OK om wat privacy weg te geven als het voor het grotere goed is."

Naarmate de technologie steeds krachtiger wordt, lijkt het steeds minder redelijk om privacy te verwachten. De gedachte gaat ongeveer als volgt: "Als technologie alles van me weet en me beter kent dan ikzelf, kan technologie me helpen betere beslissingen te nemen." Maar deze gedachte gaat ervan uit dat technologie doet wat het beste voor je is of dat technologie neutraal is. Leuk weetje: dat is het niet. Ze is eigendom van mensen en instellingen die hun eigen doelen hebben, en zij hebben de macht om technologie zo vorm te geven dat ze in de eerste plaats hun doelen dient.

Gezien wat technologie kan doen - en misschien nog belangrijker, wat zij zal kunnen doen - zou het kunnen lijken alsof het verlangen naar privacy de verbetering van de technologie zou tegenwerken of vertragen.

Maar we mogen één cruciale waarheid hier niet vergeten: Mensen hebben de technologie uitgevonden, en die moet er zijn om mensen te dienen. Wanneer grote instellingen zoals bedrijven gebruik maken van bewakingstechnologie voor hun eigen doeleinden, is dat misschien niet altijd voor het "grotere goed", maar eerst voor dat specifieke bedrijf.

Het verliezen van onze privacy zou ons een grote dienst bewijzen. Daarom kunnen we niet passief toestaan dat technologische vooruitgang ons die ontneemt in naam van "het verbeteren van de kwaliteit van de wereld". In sommige opzichten kan het inderdaad bijdragen aan het grotere goed, maar we moeten ons afvragen: Tegen welke prijs?

We mogen in geen geval gedwongen worden om onze privacy, ons denken en onze besluitvorming op te offeren voor de verbetering van de technologie.

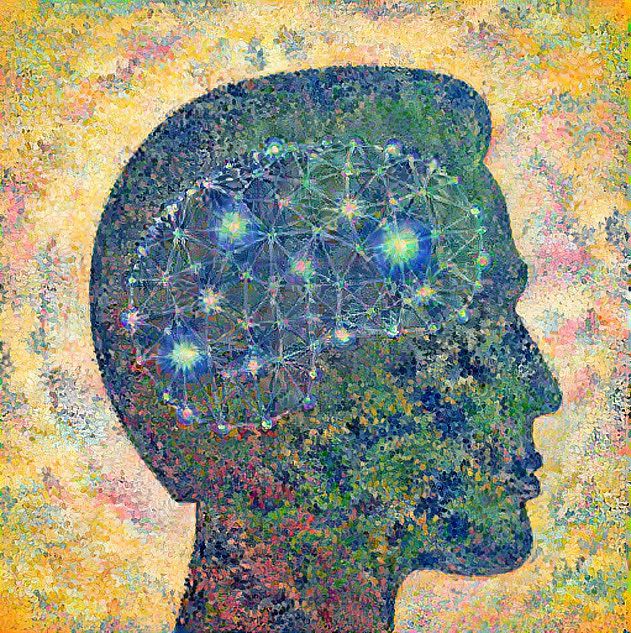

Gedachte 2: Computers zijn veel slimmer dan ik.

Het valt niet te ontkennen dat computers tegenwoordig tot buitengewone dingen in staat zijn, en hun verwerkingskwaliteit zal in de toekomst waarschijnlijk alleen maar toenemen. Ze kunnen vraagstukken en berekeningen in seconden oplossen waar het menselijk brein normaal gesproken meerdere dagen over zou doen, en het kost ze een fractie van de energie die wij zouden gebruiken om dat te bereiken. Echter...

...computers zijn geen mensen. Ze hebben geen emoties; ze voelen niets. Ze zijn niet in staat om alles wat er in de wereld gebeurt in de juiste context te plaatsen. Ze kunnen risico's berekenen, maar niet het emotionele gewicht van een verlies, noch de sensationele impact van een overwinning. Het leven is voor hen niets anders dan getallen die op een bepaalde manier zijn gerangschikt. Zij zijn afhankelijk van numerieke modellen en voelen de aanzienlijke chaos van de werkelijkheid niet aan zoals mensen dat doen. Zij voelen niet het verschil tussen het vernietigen van een kleuterschool voor een goed doel of het niet kunnen vasthouden van de hand van de liefde van je leven op een mooie late avond, alleen om de gemiddelde slaapuren te verhogen.

Deze technologische beperkingen worden vaak niet opgemerkt of niet overwogen omdat menselijke waarden zo inherent natuurlijk voor ons zijn. Toch zijn er, net als bij mensen, "machinefouten" - factoren die via getallen niet te berekenen zijn - en reacties of uitkomsten die niet gemakkelijk in code te vertalen zijn. Het resultaat is dat wij, hoewel zij zeer krachtig zijn in het oplossen van specifieke problemen, niet elke denkbare beslissing kunnen en mogen uitbesteden aan een computer om onze werklast te verminderen. Sommige beslissingen vereisen menselijke inbreng, maar als machines worden gebruikt - of toegestaan - om ze te nemen zonder "echte" toetsing, kunnen ze gemakkelijk ongekende problemen veroorzaken naarmate de technologie verbetert.

(We zien dit momenteel in de toegenomen oppositie en haat tussen groepen mensen die liever op een andere kop klikken waar ze het mee eens zijn dan een eerlijk en goed gesprek voeren met iemand die een andere overtuiging heeft. Deze situatie is verergerd, zo niet veroorzaakt, door algoritmen die de hoeveelheid tijd die gebruikers online doorbrengen optimaliseren).

Gedachte 3: "Deze hulpmiddelen helpen ons onze doelen te bereiken."

Albert Einstein maakte ooit een geestige opmerking die dit probleem perfect beschrijft: "Perfectie van middelen en verwarring van doelen lijkt onze tijd te kenmerken."

Als je met een hamer loopt, lijkt alles op een spijker. Hetzelfde geldt voor technologie en de hulpmiddelen die zij biedt. We zien de wereld door de bril van deze instrumenten, dus zoeken we voortdurend naar manieren om ze te gebruiken. Bedrijven die instrumenten hebben om personen te volgen, zoeken voortdurend naar betere manieren. Wanneer Google bijvoorbeeld op zoek gaat naar trackingalternatieven om cookies te vervangen, wil het nog steeds profielen van zijn gebruikers aanmaken. Maar waarom?

Een gezondere aanpak zou zijn om ons af te vragen*"wat willen we bereiken?*" in plaats van naar onze tools te kijken en ons af te vragen hoe we ze kunnen gebruiken in ons streven.

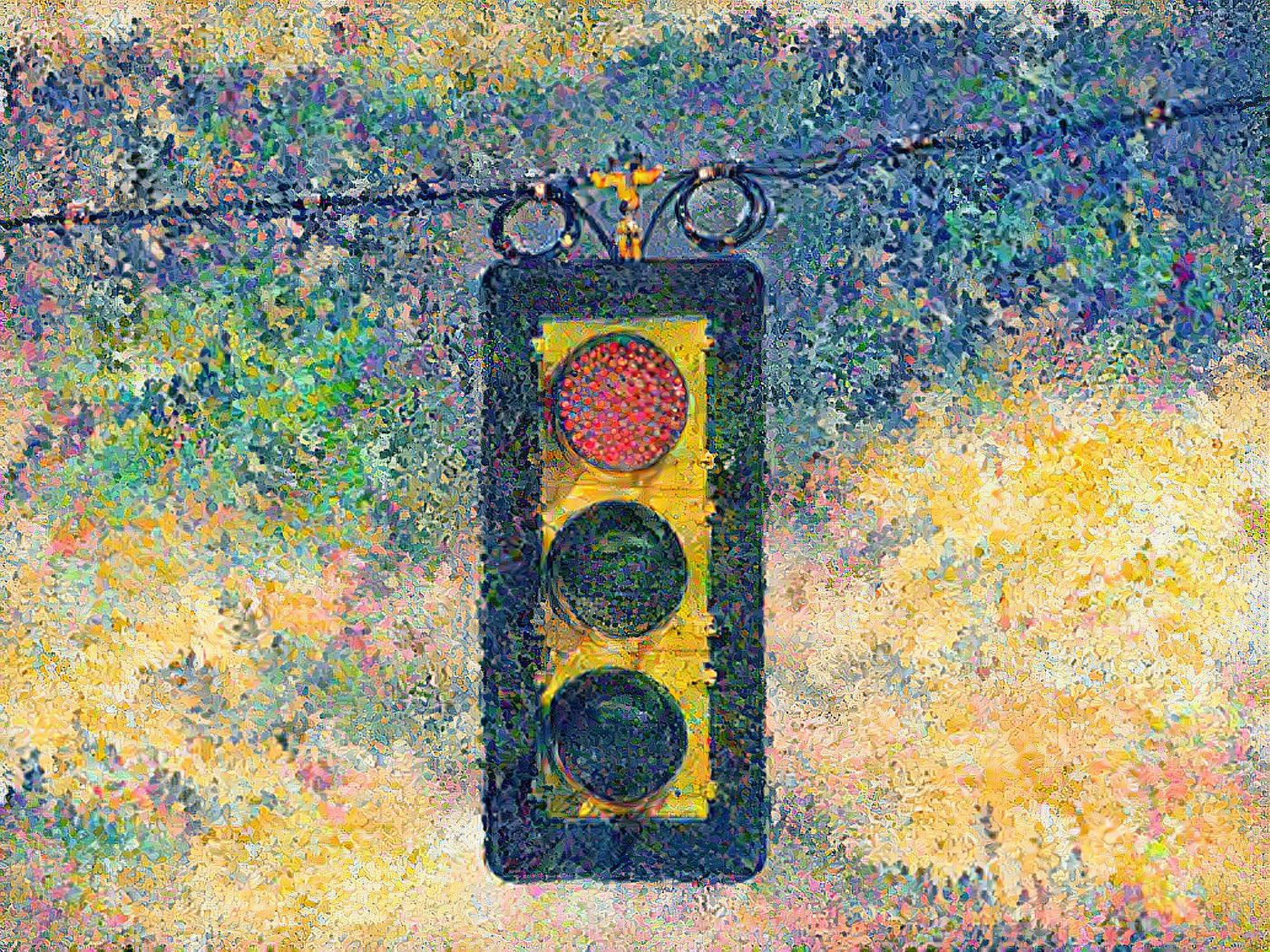

Een mooi voorbeeld is de installatie van roodlichtcamera's in de stad. Op het eerste gezicht lijkt het een zeer redelijke maatregel tegen automobilisten die het niet zo nauw nemen met de verkeersregels: Ze worden financieel gestraft. Na verloop van tijd kan de stad echter gaan rekenen op de inkomsten uit deze overtredingen en steeds meer geïnteresseerd raken in het geven van boetes dan in het tegenhouden van bestuurders die door rood licht rijden. Het probleem is niet opgelost, maar het is tenminste gekapitaliseerd. De focus zou dan kunnen verschuiven naar het vergroten van de effectiviteit van de camera's, omdat dat meer geld kan opleveren zonder het onderliggende probleem op te lossen.

Daarom moeten we ons, voordat we naar de instrumenten kijken, eerst afvragen wat we willen bereiken. Pas dan kunnen we nadenken over de noodzakelijke veranderingen die ons de gewenste resultaten opleveren en goed zijn voor de wereld.

Gedachte 4: "Technologie zal altijd de oplossing blijven en niet het probleem worden."

We denken misschien vaak dat welke innovaties ook op tafel komen, ze alleen maar goed kunnen zijn voor de wereld. Waarom zouden vernieuwers immers iets ontwikkelen dat niet goed is voor onze kostbare planeet Aarde? Zeker, de meeste grote dingen zijn ontwikkeld met een goede bedoeling, maar goede bedoelingen zelf garanderen niet altijd ook goede resultaten. U kunt zich waarschijnlijk minstens één geval herinneren waarin u van harte iets goeds wilde doen, maar het om de een of andere reden vreselijk verkeerd uitpakte. Ook innovatoren worstelen hier soms mee.

We weten nu dat de oplossingen van vandaag vaak de problemen van morgen worden (of ertoe bijdragen).

Dat komt omdat we volledig geloven dat we de technologie altijd onder controle hebben, terwijl het in werkelijkheid vaak andersom is. We zijn ons niet altijd bewust van het langetermijneffect van onze oplossingen, en zelfs als ze het op dat moment uitzonderlijk goed doen in onze wereld, kunnen ze in de toekomst uitgroeien tot een enorm probleem. Daarom moeten we ons altijd afvragen: Als we besluiten deze "vrije" technologie te aanvaarden en te gebruiken, waar kan het dan toe leiden als we haar door de deuren van de vrijheid laten lopen?

Gedachte 5: "Uiteindelijk beslis ik."

Grote techbedrijven doen erg hun best om ons het gevoel te geven dat we de controle hebben, want als we het gevoel hebben dat we de controle hebben, geloven we dat we alles kunnen doen wat we willen.

Hoewel er gevallen zijn waarin dit ongetwijfeld waar is, zijn onze opties en alternatieven in werkelijkheid meestal minder "vrij gekozen" dan ze op het eerste gezicht lijken. Als het u bijvoorbeeld niet bevalt hoe een bepaalde dienst uw gegevens behandelt, kunt u altijd stoppen met het gebruik van die dienst. Dit klinkt heel eenvoudig, terwijl we allemaal weten dat een dergelijke beslissing meestal gepaard gaat met veel andere complexiteiten en problemen. Dus, als u besluit die dienst te blijven gebruiken, betekent dat helaas dat u ook toestemming blijft geven voor de exploitatie en onjuiste behandeling van gegevens. Het is gewoon onethisch om dergelijke ultimatums aan te bieden.

Daarom zal Simple Analytics nooit iemand zulke ultimatums geven. Het is onze taak om de privacy te beschermen en tegelijkertijd snelle en toegankelijke inzichten te leveren. We volgen nooit en te nimmer bezoekers, en we zijn geen eigenaar van uw gegevens. We hebben pakketten voor elk type budget. U bent altijd eigenaar van uw gegevens, en u kunt beslissen of u ze wilt downloaden of verwijderen wanneer u maar wilt. En ja, dat komt met een monetaire prijs. Maar wij geloven dat die prijs het waard is om ieders fundamentele recht op vrijheid en privacy te beschermen.

En u? Kunt u enkele van de redenen aanwijzen waarom u hebt ingestemd met het gebruik van technologie, zelfs als u wist dat het uw privacy zou kunnen stelen? Laat het ons weten!

Dit artikel is geïnspireerd door een spannende onderzoeker genaamd Gary Marx. Een tijdje geleden stuitte ik op een academisch artikel van deze Amerikaanse socioloog en ik vond zijn bevindingen zeer toepasselijk op de huidige tijd. Kunt u de denkfouten om u heen herkennen? Ik ben zo vrij geweest enkele van zijn gedachten te vereenvoudigen en ze te herschrijven in een meer begrijpelijke, conversationele toon. Als dit artikel je bevalt en je bent geïnteresseerd in meer informatie over zijn werk over massasurveillance, bekijk dan Gary's website: https://web.mit.edu/gtmarx/www/garyhome.html

Gary zei het perfect: "De omstandigheden van het moderne leven zijn vaak zodanig dat men zich nauwelijks kan onttrekken aan het kiezen van handelingen die onder toezicht staan. Hoewel het toezicht op andere gronden gerechtvaardigd kan zijn, is het onoprecht om het een vrije en geïnformeerde keuze te noemen."

Als u dit artikel met plezier hebt gelezen en meer wilt weten over privacy, overweeg dan een abonnement op de nieuwsbrief over privacy.

Elke maand geven wij u korte, lieve en inzichtelijke privacy updates en helpen wij u op de hoogte te blijven. Onnodig te zeggen dat onze e-mails nooit iets traceren. We willen het woord verspreiden en meer mensen bewust maken van de gevaren van gegevensuitbuiting. Ook stellen we ethische oplossingen of andere privacy-gerichte apps voor. U kunt zich gratis abonneren op theprivacynewsletter.com.